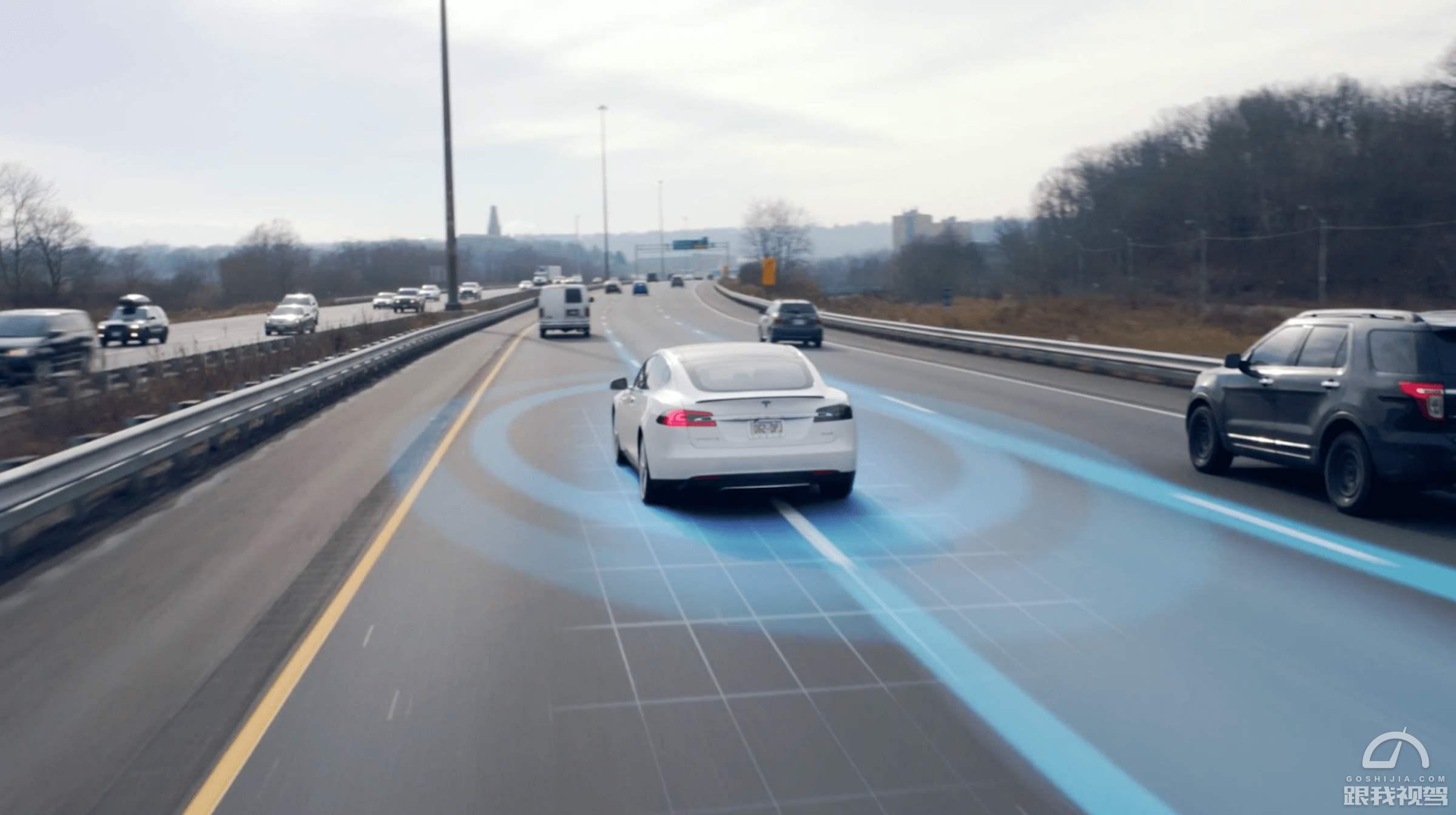

近日,我国台湾省某高速路段就发生了一起因特斯拉辅助驾驶故障而引发的车祸,当时一辆启动AutoPilot的Model 3以110km/h的时速正常行驶,在遇到前方发生交通事故而侧翻的厢式货车时,这辆车并未及时侦测到障碍并执行制动,而是径直撞上了倾覆的货箱。令人费解的是,倒在路中的货箱实际上比正常的交通参与者有更大横截面积、更易被雷达识别,但在自动驾驶领域不断进化的AutoPilot却不能作出正确的判断,这让人难以接受,而事实上,这套“领先”的驾驶辅助系统已在类似于“静止障碍”的场景中载过不少跟头。

从2016年至今,搭载AutoPilot的特斯拉车型在全球已陆续发生了多起事故,原因均是辅助系统并未对停靠的或是缓慢移动的车辆作出正确判断,从而导致一次次地撞向类似的静止物体,造成巨大的人身财产损失。

实际上,AutoPilot在几年间的进步是有目共睹的,无论是传感器数量还是软件算法都进行了数次升级,但如今更为先进、传感器更完备的系统却依旧存在上面的“老问题”,那就是无法准确判断静止障碍物,即使其体积再大、位置再明显,均会发生漏判而导致撞击,这究竟是哪里出了问题呢?

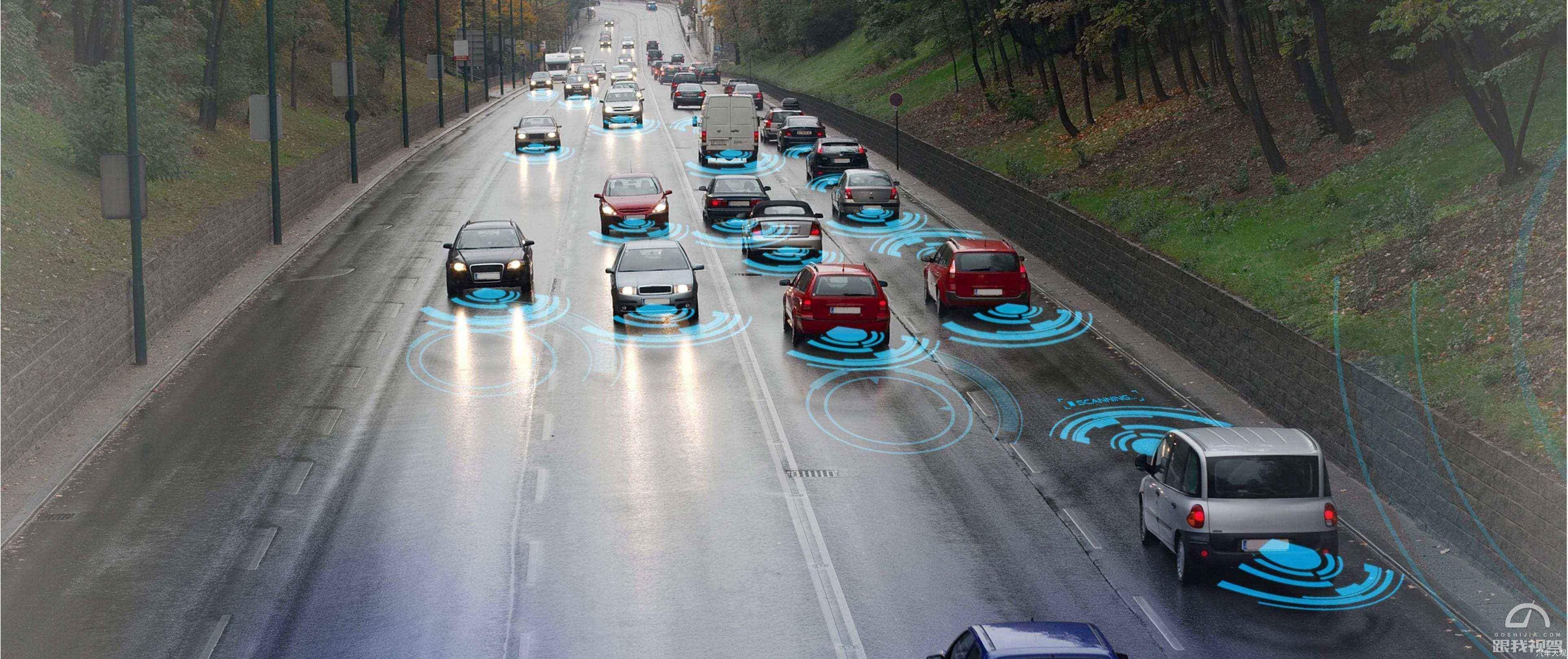

其实像AutoPilot这样对静止障碍物发生误判的情况属于各个品牌辅助驾驶系统的“通病”,人们对此无非存在两种猜测,要么是传感器失灵,要么是算法有缺陷。对于第一种猜想,在几年前采用单目雷达和单一摄像头的时代或许还说得通,但就目前来讲,特斯拉已在AutoPilot车型部署了1颗毫米波雷达、8颗摄像头以及12颗超声波雷达,它们全体失灵的几率微乎其微。

既然传感器不背锅,那症结是否在系统算法上呢?实际上,自动驾驶算法并非一朝一夕能完善的,它需要海量的“经验”,像谷歌Waymo这样的顶尖系统也还在不断“学习”当中,这种学习针对的是世界上所有可能存在的交通突发状况,而对于撞击货箱这例事故来说,很可能是因为工程师在系统图像训练中并未加入“倾覆的货箱”这一模型,再考虑到其白色导致的高光反射,系统摄像头说不定认为它是马路的一部分。

而有小伙伴可能会问,你不是还装了十多颗超声波雷达吗,雷达为何难以阻止事故发生呢?这就涉及到系统算法的基本逻辑了,试想若无差别地依靠雷达信号作为判断指标,那么很多墙、桥以及路牌均会使系统发生频繁误报,从而车辆根本无法正常行驶,所以问题基本可以归结为自动驾驶的学习体量和逻辑上对于图像信息与雷达信息的权重比了,当然这依然不是一朝一夕能解决的问题。

写在最后:

未来的自动驾驶将完全颠覆人们的生活模式,但在这之前,需要解决的问题还有不少,比如更高级、更安全的算法,再比如更精确的激光雷达的普及问题等,这些都不是一蹴而就的问题,虽然一次次事故打击着人们对自动驾驶的信心,但我们依然需要对它抱以希望,毕竟它才是以后汽车这一灵活交通工具的发展方向。

评论

() 先登录 发表暂无评论

点击展开更多评论